Ho trovato alcuni articoli molto interessanti su questo argomento. Riporto solo quello che mi è sembrato semplice da comprendere. Purtroppo la maggior parte degli articoli che si trovano sul web sono di autori incapaci a spiegare.

La facoltà dell’attenzione umana è un’abilità cruciale nella comprensione del linguaggio naturale.

Ogni volta che leggiamo o ascoltiamo un testo, la nostra mente seleziona le parole chiave e le relazioni semantiche per ottenere una comprensione del significato complessivo.

Ma come può essere emulata questa capacità di selezione attenta del linguaggio naturale da parte dei computer? L’architettura del Transformer, una delle più recenti e avanzate tecniche di elaborazione del linguaggio naturale, offre una risposta convincente.

Il Transformer utilizza un meccanismo di attenzione sofisticato per selezionare attentamente i token in un testo.

Il Transformer è un modello di** rete neurale** che utilizza la meccanica dell’attenzione , in cui il modello assegna un peso alle diverse parti dell’input in base alla loro rilevanza per la comprensione del testo.

L’idea geniale è stata quella di introdurre un meccanismo che permette di focalizzare l’attenzione su particolari elementi della sequenza e di stabilire i riferimenti tra essi.**.

Proprio come durante l’ascolto o la lettura di una frase il cervello umano si focalizza su alcune parole di maggiore importanza e stabilisce i riferimenti tra pronomi, sostantivi e altre entità, una rete neurale costruita sulla base di un modello transformer è in grado di individuare le parole importanti della sequenza di input e stabilire i loro riferimenti con una migliore comprensione del testo.

Consideriamo due frasi simili prese da un link di approfondimento citato a fine paragrafo:

“l’animale non attraversò la strada perché era troppo stanca”

“l’animale non attraversò la strada perché era troppo larga”

Non è semplice (per un sistema software) stabilire che nella prima frase “troppo stanca” si riferisce all’animale, mentre nella seconda frase, “troppo larga” si riferisce alla strada.

Un modello equipaggiato con le funzionalità di un Transformer è in grado di dare il peso corretto alle parole nelle due frasi ed è in grado di distinguere a chi sono riferite le parole “troppo larga” o “troppo stanca” nella frase.

Attenzione a più teste

I trasformatori funzionano fondamentalmente così. Ci sono alcuni altri dettagli che li fanno funzionare meglio. Per esempio, invece di prestare attenzione all’altro in una sola dimensione, i trasformatori utilizzano il concetto di attenzione multitesta.

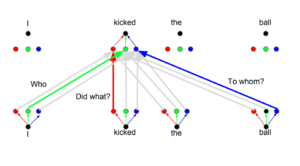

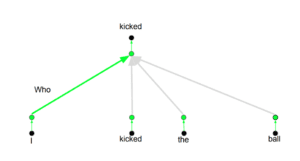

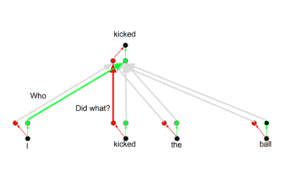

L’idea alla base è che ogni volta che si traduce una parola, si può prestare un’attenzione diversa a ciascuna parola in base al tipo di domanda che si sta ponendo. Le immagini seguenti mostrano cosa significa. Ad esempio, quando si traduce “kicked” nella frase “I kicked the ball”, si può chiedere “Who kicked”. A seconda della risposta, la traduzione della parola in un’altra lingua può cambiare. Oppure si possono fare altre domande, come “Ha fatto cosa?”, ecc.[mia nota: ecco questo è chiarissimo secondo me]